次世代言語モデルとなる可能性を秘めたGoogle Gemini

AI競争がかつてないほど激化する中、Googleは近年、LLM AIファミリーの拡大を続けています。

現在、GoogleファミリーにはPalm、Bard、Gemini、Gemma AIモデルがあり、検索、広告、Bardなど、さまざまなGoogle製品で動作するように設計されています。

この記事では、Google GeminiファミリーのLLM AIモデルについて詳しく解説し、それぞれの長所と短所を見ていきます。これにより、ビジネスニーズに合わせてモデルを選択・導入する際に役立ちます。

目次:Google Gemini

Gemini AIとは何か、そして何ができるのか

Google Geminiは次世代生成型AIモデルファミリーです。このモデルファミリー全体は、GoogleのAI研究機関であるDeepMindとGoogle Researchによって開発されました。

3つのオプションがあります。

- Gemini Ultra:Geminiのフラッグシップモデル。

- Gemini Pro:Geminiモデルの軽量版。

- Gemini Nano:より小型の言語モデル。

すべてのGeminiモデルはマルチモーダルに対応するようにトレーニングされています。つまり、テキストや単語だけでなく、様々なデータを扱うことができます。多様な音声、画像、動画、膨大なコードベース、そして様々な言語のテキストを用いて事前学習とファインチューニングが行われています。

ただし、テキストデータのみでトレーニングされたGoogle独自のLaMDAなどのモデルとは異なります。

LaMDAはテキスト以外のものを理解したり生成したりすることはできませんが、Geminiファミリーのモデルはそれが可能です。

Gemini Pro

Gemini Proは、スケーラビリティとパフォーマンスのバランスに優れたGoogleのAI機能の重要なバージョンです。UltraおよびNanoバージョンを含むGoogle Gemini AIファミリーの一員です。Gemini Proは様々なタスクでの使用を想定して設計されており、開発者や企業が活用できるようになっています。

Gemini Proはマルチモーダルモデルでもあり、テキスト、画像、音声、動画、コードを理解し、処理することができます。

より高度な推論、計画、理解のために微調整されており、幅広いアプリケーションに対応できる汎用性と強力なツールとなっています。

さらに、開発者や企業は、Google AI StudioとVertex AIを通じてGemini Proにアクセスできます。Gemini API経由でも利用可能で、開発者はローコード環境でGeminiを搭載した検索エージェントや対話型エージェントを構築できます。Gemini Proは、Google CloudのエンドツーエンドAIプラットフォームであるVertex AIでも利用可能で、開発者は数時間から数日で本番環境レベルのAIエージェントを作成できます。

Gemini Proは、研究ベンチマークにおいて優れたパフォーマンスを発揮し、同規模の他のモデルを凌駕しています。

テキスト用のコンテキストウィンドウは32Kバイトで、将来のバージョンではさらに大きなコンテキストウィンドウが搭載され、機能がさらに強化される予定です。

Gemini Ultra

Gemini Ultraは、Googleの大規模言語モデルファミリーの中で最も強力で高度なバージョンです。非常に複雑なタスクに最適化されており、テキスト、画像、動画、音声、コードなど、さまざまな形式のデータをシームレスに推論できます。Gemini UltraはGemini ProおよびGemini Nanoと同じコードをベースに構築されていますが、異なるユースケース向けに設計されています。最大規模のモデルであり、最も複雑なタスクに最適化されています。

Gemini Ultraは、最も複雑なタスク向けに設計された最大規模のモデルです。

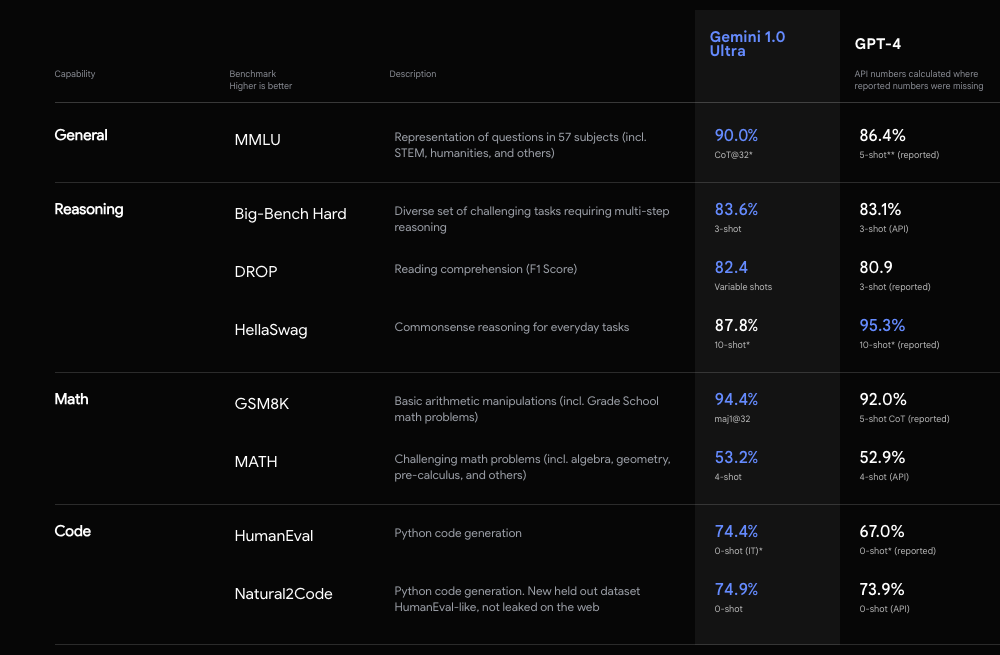

MMLU、Big-Bench Hard、HumanEvalといったLLMベンチマークではGPT-4を上回り、MMMU、VQAv2、MathVistaといったマルチモーダルベンチマークではGPT-4Vを上回りました。

以下のGoogle Gemini UltraとGPT-4の比較表からもわかるように、Google Gemini Ultraは独自の製品価値提案を持ち、多くのパフォーマンスにおいて際立っています。これは数多くの実例からも証明されています。

Gemini Nano

Gemini Nanoは、使いやすさと迅速なモデル開発のために設計された、小型で俊敏な言語モデルです。シンプルなユーザーインターフェースと自動化されたワークフローを備えているため、技術的な知識のないユーザーでも簡単に利用できます。

Gemini Nanoは、スピードと柔軟性を重視しており、ユーザーはモデルを迅速に反復開発し、さまざまなデータシナリオを探索できます。

しかし、非常に複雑なデータや高度なモデリング要件を扱う場合には、限界がある可能性があります。

Gemini Nanoは、迅速なプロトタイピング、探索的分析、そしてシンプルさと効率性が最優先されるユースケースに最適です。例えば、GoogleはGoogle Pixel 8にGemini Nanoを搭載し、パフォーマンスを向上させると発表しています。

Google Gemma

Google Gemini LLMファミリーの他の3つのモデルとは異なり、Google Gemmaは軽量でオープンソースの言語モデルの分野で魅力的な製品を提供します。

Gemmaモデルは、他の最先端モデルと比較して、より小型でリソース効率に優れているように設計されているため、モバイルデバイスやエッジコンピューティング環境など、さまざまなプラットフォームへの展開に適しています。

Gemmaは、TensorFlow、PyTorch、JAX、Hugging Face Transformersといった主要なフレームワークをサポートすることで柔軟性を提供し、開発者は好みのツールを活用できます。Googleは、Gemmaの開発において、責任あるAIの原則を最優先事項としています。自動フィルタリングや人間からのフィードバックに基づく強化学習(RLHF)などの技術は、バイアスを軽減し、モデルの責任ある動作を促進することを目的としています。

Gemmaの限界は、現在のところテキスト間変換タスクに特化している点です。

感情分析や質問応答などの他の自然言語処理機能との統合には、追加の検討が必要になる場合があります。

Gemini AI の価格

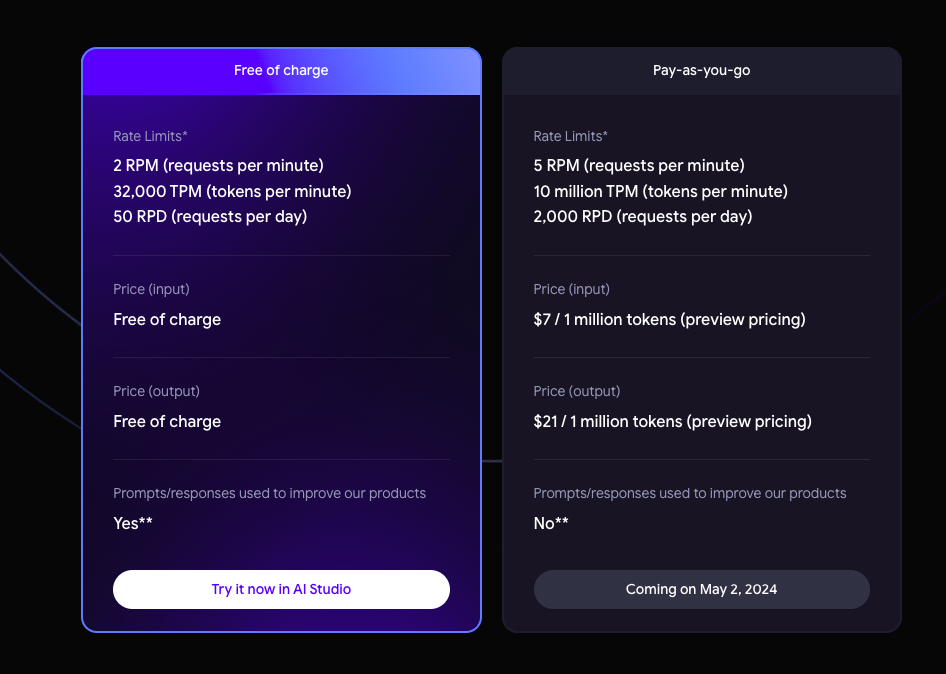

OpenAI や ChatGPT4 と同様に、Google Gemini にも 3 つの主要な料金プランがあります。1 つ目は、月額制のサブスクリプションプランである Google Gemini Ultra です。Gemini Ultra の価格は月額 20 ドルです。2 つ目は、開発者や企業向けの Google Gemini Pro API に基づく従量課金制です。

詳細画像は以下のとおりです。

最後に、Google GeminiはGemini APIとGemini AI Studioの両方で無料プランを提供しており、ユーザーと開発者は誰でも試用できます。

結論

どのモデルにも長所と短所があり、実際のニーズ、目的、ビジネス目標によって最適なモデルは異なります。今後追加される新機能により、AI開発の急速な進展とAI分野における激しい競争から、より多くの恩恵を受けることができると確信しています。